نتابع الإجابة على أسئلة فهد العييري في مقاله فلسفة الذكاء الإصطناعي:

للتذكير فقط، الاجوبة على الأسئلة السابقة مهمة لفهم وجهة نظري في الموضوع لأني أسست فيها تعريفات سأبني عليها أحكامي هنا.

وإليكم روابط المقالات السابقة، الجزء الأول، الثاني، الثالث.

سؤال الاستاذ فهد العييري:

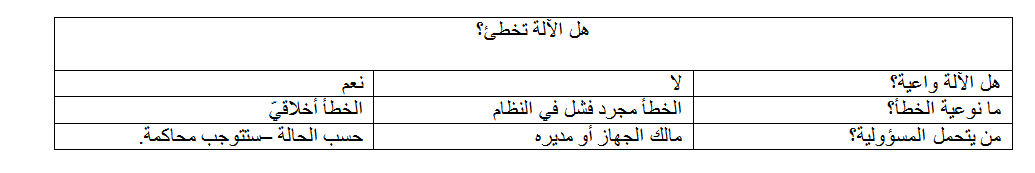

هل الآلة تخطئ؟

أعتقد أنه يقصد بالخطأ هنا الخطأ الاخلاقي وليس (الفشل في النظام) كعادة الالات العادية. لذلك الاجابة عن هذا السؤال تتطلب أولا ان تكون الالة واعية لماذا؟ لان ارتكاب خطأ اخلاقي او جنحة او جريمة أو فعل مخالف للقانون يتطلب أمور مسبقة من بينها: الوعي- حامل الوعي عاقل – على دراية بالقانون الاخلاقي الذي خالفه – الوقت الذي خالف فيه ذلك القانون كان واعيا وعاقلا بذلك لا مكرهاً او مغيب الوعي.

سنلخص الاجابة في هذا الجدول كون خبراء الذكاء الصناعي يحبون الجداول والشبكات والبيانات التخطيطية:

بالتالي الالة دون وعي يمكن ان يحدث لها ثغرات برمجية وفشل في النظام اما ان كانت واعية فلا بد من الشروط التي ذكرناها كي نعتبر أنها أخطأت. اذن هي في كلتا الحالتين (بوعي او بدونه) تخطأ غير ان الخطأ في الحالة الاولى (دون وعي) هو خطأ تقني عادي نعرف امثاله كثيرا الان اما الحالة الثانية فهو خطأ أخلاقي وهذا ما يقودنا الى الجزء الاخر من السؤال:

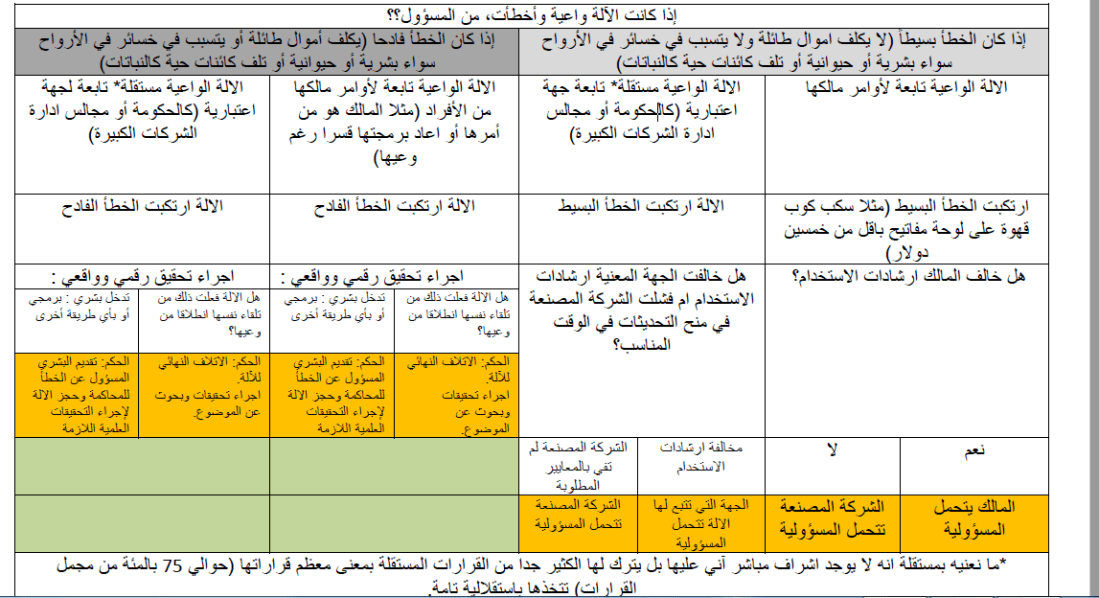

وإذا أخطأت، هل هي المسؤولة عن هذا الخطأ؟ أم المصنع، المبرمج، الناشر، المالك، المستخدم؟ هل يمكن أن نحمل الآلة أصلاً المسؤولية؟

لقد أسلفنا القول أن الالة لا بد ان تكون واعية ان كنا نتحدث عن (خطأ أخلاقي) أو مخالفة لقانون أخلاقي ما، أما ان لم تكن واعية فالجدول الأول -أعلاه- يجيب عن قضية المسؤولية وهو واضح. لكن لنفترض أن الالة واعية وأخطأت خطأ معينا أخلاقيا فمن هو المسؤول؟

الاجابة حسب الجدول التالي:

لتحميل الجدول بصيغة pdf.رابط مباشر

رأيان حول “محاولة الاجابة على أسئلة فهد العييري في الذكاء الصناعي (الجزء 4)”